[이데일리 김현아 기자]

| | 장병탁 서울대 교수 |

|

장병탁 서울대 컴퓨터공학부 교수가 6일 광진구 워커힐 호텔에서 열린 SK텔레콤의 제1회 AI 컨퍼런스 ‘ai.x 2018’에서 “현재의 인공지능(AI)은 사람과 비교할 때 지능이 낮다”며 “이제 AI의 패러다임을 전환해야 한다. 결국 실생활에서 리얼타임으로 학습하는 머신러닝 알고리즘을 연구해야 한다”고 말했다.

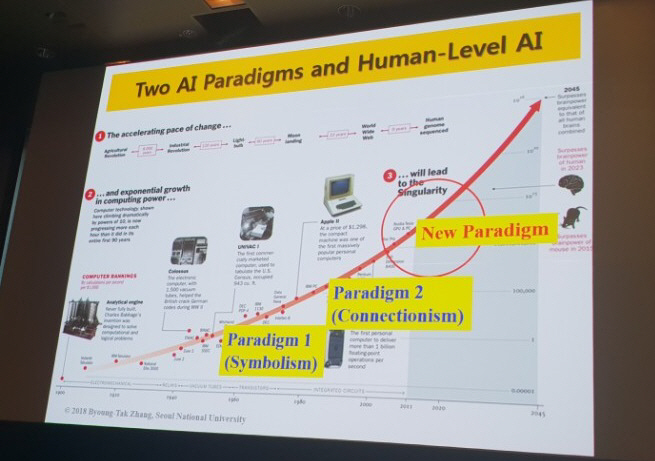

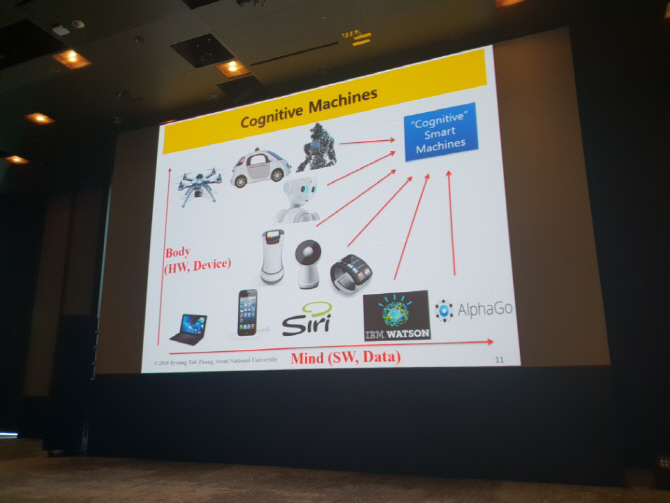

장 교수가 평가한 인공지능 알고리즘은 1단계인 연역적 추론을 쓰는 상징주의(Symbolism)에서 귀납적 추론을 쓰는 2단계인 연결주의(Connectionism)을 지나 새로운 단계로 진화하고 있다.

그는 “1단계에선 지식에 기반해 집어 넣는 방식으로 AI를 만들었으면 지금은 데이터를 주고 기계가 AI를 발견하게 된다”며 “하지만 앞으로는 생명체가 환경 속에서 생존하는것처럼 AI 역시 실생활에서 리얼타임 학습하는 머신러닝 알고리즘(인지적(Cognitive)기계)으로 연구해야 한다”고 조언했다.

그러면서 10년간 진행 중인 프로젝트들을 소개했다.

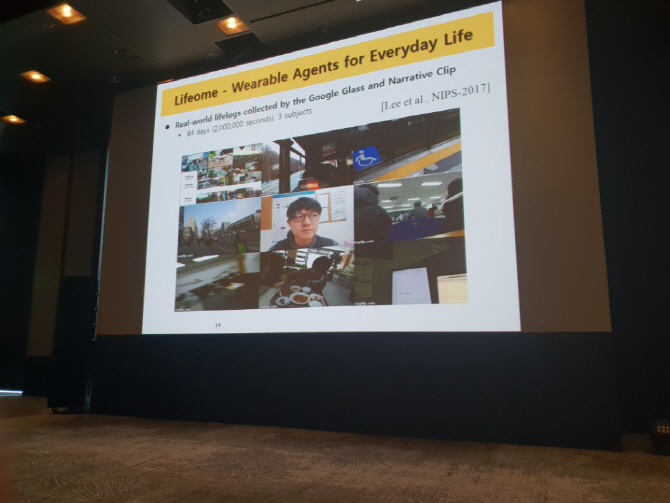

웨어러블 센서로 시작..이젠 비디오를 AI 학습데이터로장 교수는 “구글 글래스를 웨어러블 센서를 이용해 학습시키고 이를통해 인간처럼 행동과 생각을 예측할 수 있을까 실험(생각의 맵 작성)했고, 로봇도 해 봤지만 데이터가 부족했다”며 “그래서 저희는 비디오를 학습용 데이터로 써보기로했다. IBM 왓슨이 위키피디아의 글을 학습했듯이 비디오 안에 일상생활을 넣어 이를 AI가 학습하면 엄청난 지식을 가지지 않을까 하는 것이었다”고 말했다.

지난해와 올해 국제대회 우승..AI가 사진보고 자연어로 문장 만든다그의 이런 노력은 ‘2017 국제 로보컵 대회’ 우승과 ‘2018 북미 컴퓨터 언어학학회’ 시각적 스토리텔링 인공지능챌린지 우승으로 이어졌다.

작년에는 서울대 컴퓨터공학부 장병탁 교수팀이 만든 로봇 AUPAIR가 가정과 같은 일상 환경에서 서비스 임무를 수행하는 소셜 홈로봇 부문(RoboCup@Home SSPL 리그)의 8개 시나리오 과제를 모두 최고의 점수로 통과해 종합 1위를 차지했다.

지난 6월에는 장 교수와 제자들이 함께 참여한 ‘SnuBiVtt’팀이 ‘시각적 스토리텔링 인공지능 챌린지’에서 우승했다. 이 기술은 과학기술정보통신부의 인공지능 국가전략과제인 비디오튜링테스트(VTT) 프로젝트의 결과물이기도 하다.

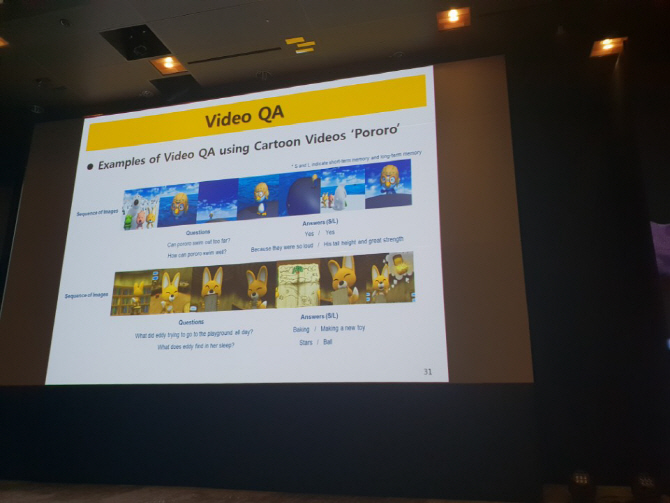

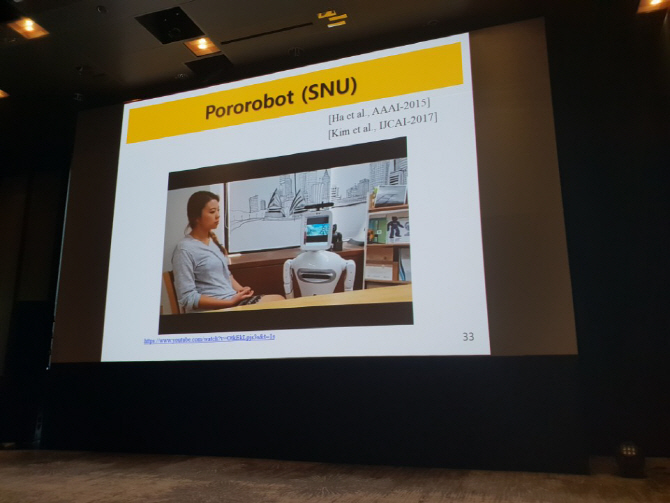

뽀로로 비디오로 학습시켜..페이스북과 막상막하

장 교수는 “만화영화는 영상처리가 쉬워 뽀로로 만화로 인공지능을 고도화했다”면서 “시각적 스토리텔링을 위한 딥러닝 모델 개발대회였는데 인공지능이 5장의 사진을 보고 자연어로 문장을 생성하는 능력을 평가했다. 기계적으로 평가한 순위는 페이스북이 1등, 우리가 2등이었고, 사람이 평가에 참여한 순위는 우리가 1등이었다”고 소개했다.

이어 “인공지능 전반은 가상세계에서 현실세계로 다가가고 있다.머신러닝 관점에서 이런 챌린지들을 연구해야한다”며 “이를테면 (음성인식으로 동작하는) AI스피커가 눈을 갖추고 가시성을 갖게 되면 프라이버시 문제가 해결될 것이다. 대화의 맥락을 목소리만으로 이해하긴 어렵다. 시각이나 촉각같은 다른 감각을 통한 도움이 필요하다”고 말했다.

![월드컵까지 따냈다...스포츠산업 '생태계 파괴자' 된 빈살만[글로벌스트롱맨]](https://image.edaily.co.kr/images/Photo/files/NP/S/2023/11/PS23110500115t.jpg)

![[포토] 폭염 속 휴식취하는 건설 근로자](https://image.edaily.co.kr/images/Photo/files/NP/S/2023/08/PS23080100718t.jpg)

![[포토]책의날 맞아 시민들에게 책 나눠주는 유인촌 문체부 장관](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300692t.jpg)

![[포토] 안병우 축산경제 대표, 청정축산 환경대상 시상식](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300549t.jpg)

![[포토] 하나로마트 창립 29주년 70% 세일](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300533t.jpg)

![[포토]세계 책의 날 맞아 문체부, 국무회의에서 국무위원들에게 책 선물](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300428t.jpg)

![[포토]국내최대 오트 함량을 담은 어메이징 오트](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300304t.jpg)

![[포토]'원내대책회의 참석하는 윤재옥'](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042300287t.jpg)

![[포토]안전을 향한 닻을 올리자](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042200782t.jpg)

![[포토]BMW그룹 코리아, 'BMW 그룹 R&D 센터 코리아' 개관](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042200677t.jpg)

![[포토] 중소기업 금융애로 점검 회의](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042200646t.jpg)

![[포토]최은우 '대회 2연패 달성'](https://spnimage.edaily.co.kr/images/Photo/files/NP/S/2024/04/PS24042100415t.jpg)